자율주행에 대한

자율주행에 대한

윤리적 고민

오늘은 여러분이 만약 운전 중 위급한 상황이 발생했을 때, 어떤 판단을 하는지에 대한 고민을 해 보겠습니다. 운전의 가장 위급한 상황이라 할 수 있는 것이 아마도 사람이 목숨이 문제가 될 때가 아닐까 합니다. 그것도 본인이 운전을 하고 있을 때, 여러 사람을 위험에 빠지게 할 상황이 발생했을 경우, 만약 순간의 판단으로 위험을 회피해야 한다면, 어떤 판단을 하게 될까요?

나를 희생하고, 여러 사람을 구할까요?

나를 희생하고, 여러 사람을 구할까요?

아니면 그들보다는 내가 더

중요하다는 판단하게 될까요?

자율주행차에 대한 장단점에 대해 얘기를 할 때, 대표적인 단점으로 설명에서 빠지지 않고, 등장하는 고민 중에 하나인 트롤리 딜레마입니다. 이에 대해 생각해 보겠습니다. 트롤리 딜레마 ( Trolley Deilemma ) 란 영국의 철학자 필리파 풋(Philippa Foot)과 미국의 철학자 주디스 바지스 톰슨(Judith Jarvis Thomson)이 고안한 사고 실험으로, 다음과 같은 윤리적 딜레마를 말합니다. 아래 사례를 통해 고민을 시작합니다.

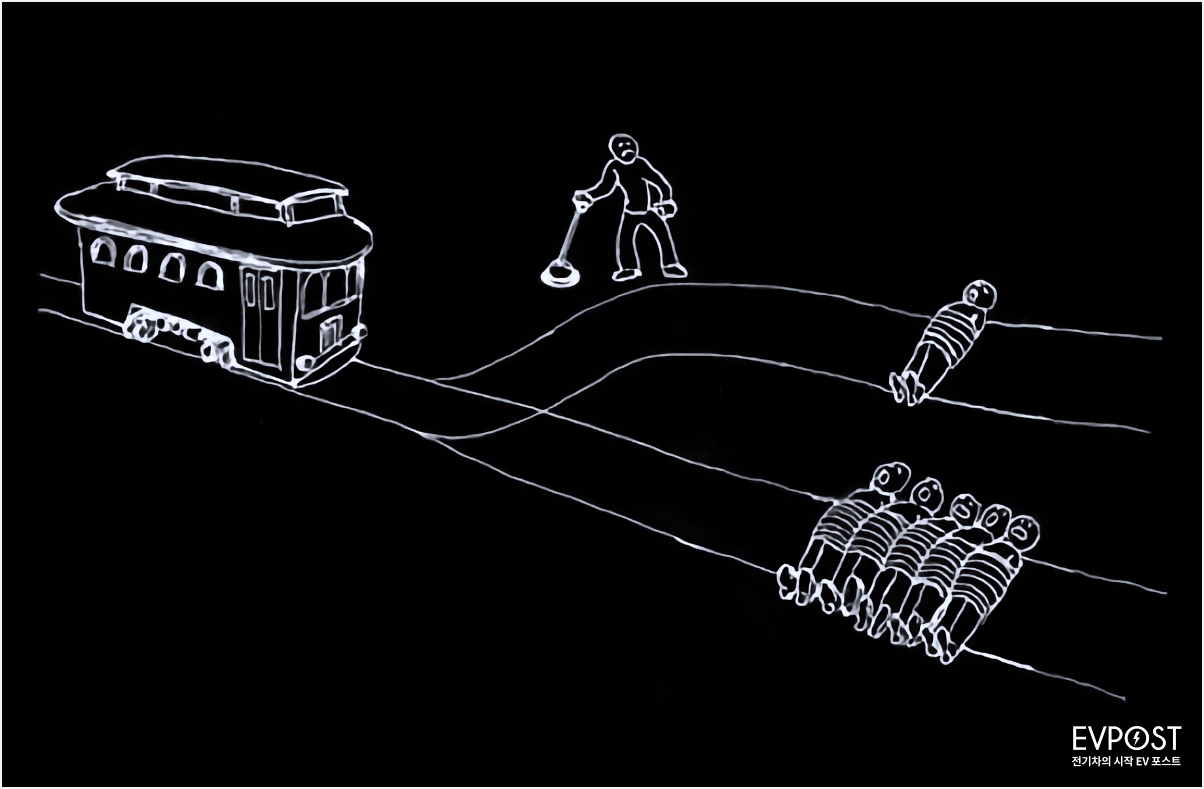

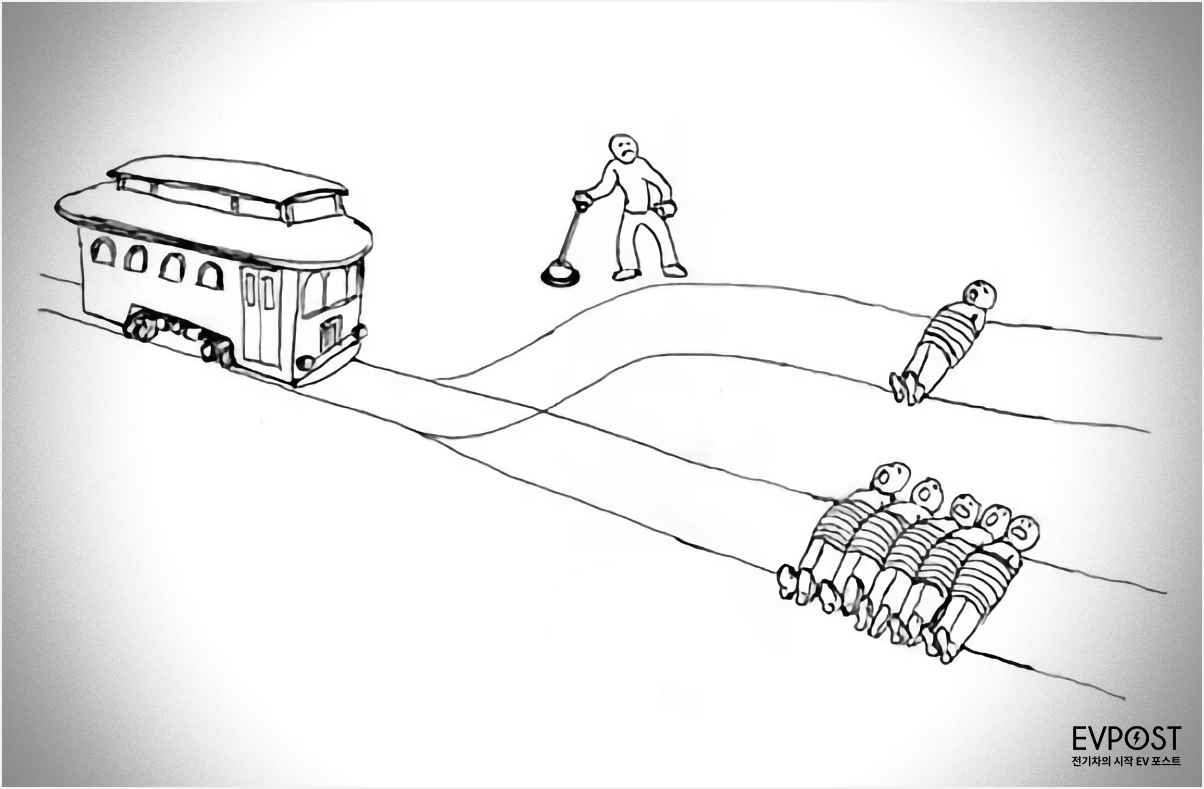

트롤리 사례

트롤리 전차가 철길 위에서 일하고 있는 다섯 명의 인부들을 향해 빠른 속도로 돌진한다. 당신은 이 트롤리의 방향을 오른쪽으로 바꿀 수 있는 레일 변환기 옆에 서 있다. 당신이 트롤리의 방향을 오른쪽으로 바꾸면 오른쪽 철로에서 일하는 한 명의 노동자는 죽게 된다. 이러한 선택은 도덕적으로 허용되는가?

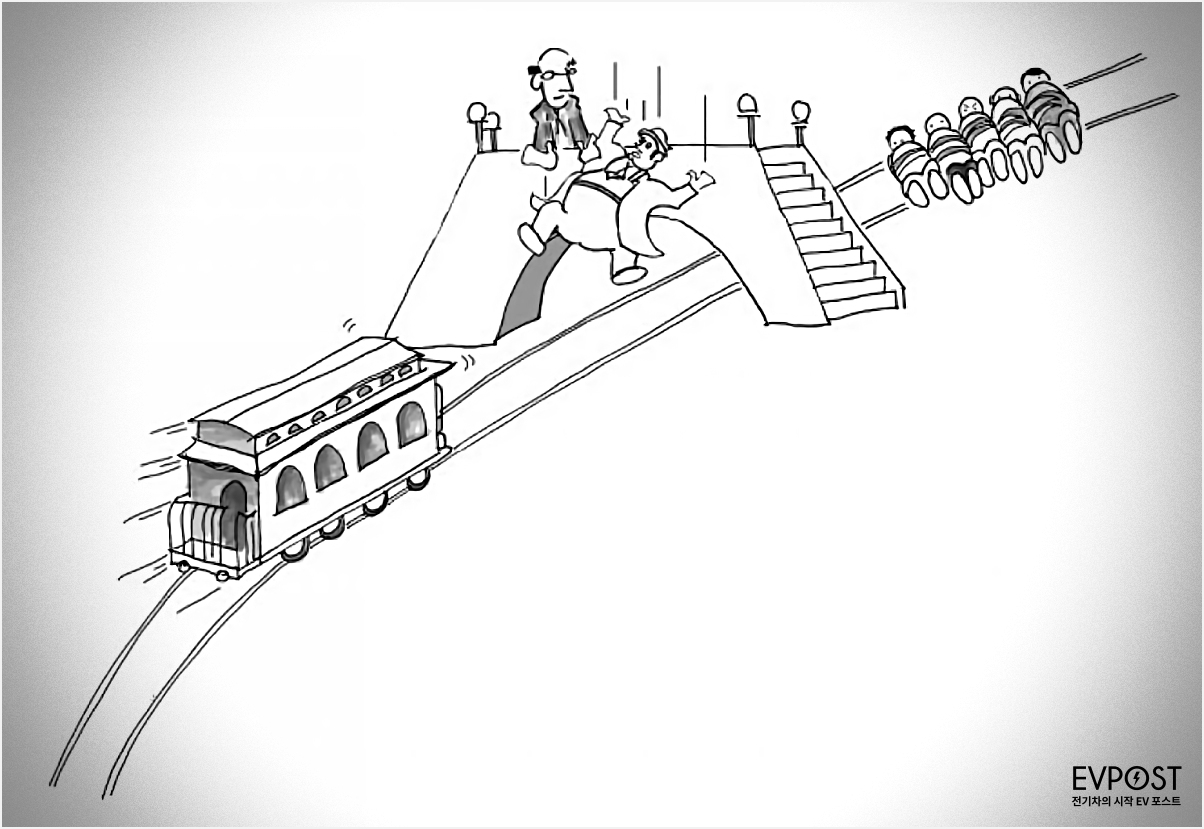

육교 사례

트롤리가 철길 위에서 일하고 있는 노동자 다섯 명을 향해 빠른 속도로 달려간다. 당신은 철길 위의 육교에서 이 상황을 바라보고 있다. 당신이 트롤리를 세우기 위해서는 큰 물건을 열차 앞에 던져야 한다. 마침 당신 앞에 몸집이 큰 사람이 난간에 기대 아래를 보고 있다. 당신이 트롤리를 세우기 위해서는 그 사람을 밀어야 한다. 떨어진 사람 때문에 트롤리가 멈추고, 철길에서 일하던 노동자 다섯 명의 목숨을 구할 수 있다. 이러한 선택은 도덕적으로 허용될 수 있는가?

위의 상황처럼 트롤리 딜레마 상황이 발생했을 때, 어떤 선택을 해야 하는지에 대한 고민을 하게 되는데, 상황에 대한 설문 조사에서 첫 번째 사례, 트롤리 사례에서는 89% 사람들이 1명을 희생할 수 있다는 선택을 했습니다. 공리주의에 따르면 한 명이 아닌 최대 다수의 행복을 위한 선택을 하는 것이 보다 나은 선택이라고 할 수 있겠지요.

하지만, 두 번째 사례에서 1명을 희생해서 5명의 인부를 구한다 할 때는 78%가 그렇게 하지 않는다고 선택했습니다. 그렇게 하면 살인을 하는 것과 다르지 않기 때문입니다. 이처럼 1명의 목숨이 다른 5명의 그것보다 가치가 없다는 것인지에 대한 심각한 고민을 하게 됩니다. 위의 사례는 자율 주행차 개발 초기부터 있던 윤리적 고민입니다. 실제 자율 주행차의 운영방식이 위급한 상황에서 사람이 아닌 이미 정의되어 있는 프로그램에 의해 판단이 되기 때문입니다.

Why Self-Driving Cars

Must be Programmed to Kill

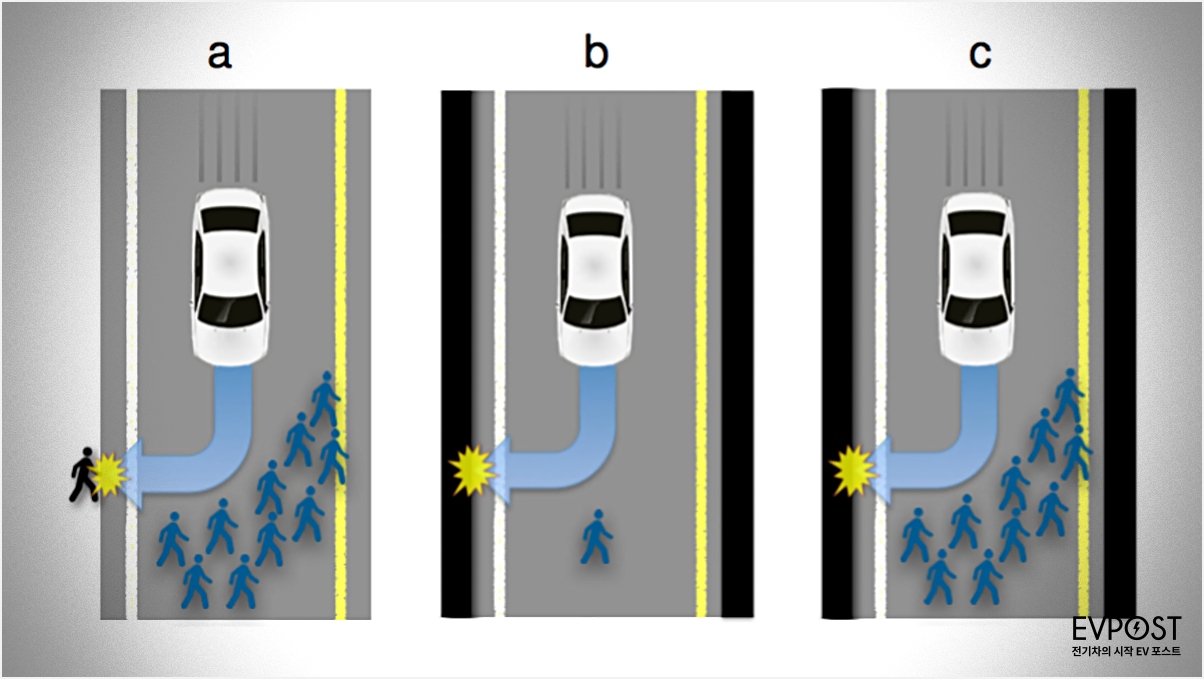

A 사례

직진을 할 경우 10명의 보행자를 치게 되고,

방향을 돌리면 1명을 치게 되는 상황

B 사례

직진을 할 경우 1명의 보행자를 치게 되고,

방향을 돌리면 자동차 탑승자가 위험한 상황

C 사례

직진을 할 경우 10명의 보행자를 치게 되고,

방향을 돌리면 자동차 탑승자가 위험한 상황

2015년에 MIT Technology Review에 자율 주행차에 대한 이와 같은 기사가 발표되었습니다. 제목은 “Why Self-Driving Cars Must be Programmed to Kill” 입니다. 위에 설명한 상황에 대한 설문조사에서 많은 사람들이 앞의 공리주의적 판단을 많이 하기는 했지만, 자율 주행차에게 요구하는 가장 큰 것은 위험을 최소화하는 자동차를 생산해야 한다고 답을 했습니다. 만약 그러한 문제가 해결되지 않은 자율 주행차라면 구매하지 않겠다고 답했다고 합니다.

참 어려운 문제이지요.

참 어려운 문제이지요.

하지만 2017년 구글의 AI 시니어 펠로우, 제프 딘(Jeff Dean)은 한 기자 간담회에서 자율 주행차의 AI (Artificial Intelligence)는 단편적인 판단을 하는 것이 아닌 사고를 막는 것을 목적으로 한다고 하였습니다. 더불어 자율 주행차의 AI는 운전 중에 문자를 하거나, 술을 먹고 운전을 하지는 않기 때문에 사고예방에 있어서는 더 많은 장점을 가지고 있다고 하였습니다. 이처럼 아직 자율 주행차에 대해 일반인과 개발자 사이에는 판단 기준에 큰 차이가 있습니다. 이러한 문제 역시 고민해봐야 할 부분이기도 합니다.

현재의 사람의 만들어 내고 있는 교통사고의 양을 생각해보면 과연 AI의 판단에 문제점을 제시할 수 있을지? 하지만 기계의 판단은 한치의 오차도 없이 정확해야 한다는 기준으로 봤을 때, 교통사고가 발생할 수 있는 경우를 생각해야 하는지?

트롤리 딜레마는 결론을 내리기 힘든 윤리적 문제이기 때문에 사회적 합의가 없이 해결할 수 없을 거라 생각합니다. 자율 주행차를 개발하고 있는 기업뿐 만 아니라 정부에서도 이런 문제에 대한 고민을 해야 할 것입니다. 이미 미국, 독일의 정부에서는 개발 업체에게 기준이 될만한 윤리적 기준을 제시하고 거기에 따라서 자율 주행차 개발을 유도하고 있습니다. 이 부분에 대한 내용은 차후에 다루도록 하겠습니다.

트롤리 딜레마, 여러분은

트롤리 딜레마, 여러분은

어떤 생각이 드시는지요?

위의 상황을 시뮬레이션 할 수 있는 사이트가 있어서 안내해드립니다. 과연 위의 상황이 자신에게 발생한다면 여러분은 어떤 판단을 하게 되실지 한 번 해보시면 어떨까요? 아래 링크를 열어보시면 테스트를 해보실 수 있습니다. 저도 해봤는데, 생각보다 고민을 많이 하게 됩니다. 테스트를 끝내고 결과를 보여줍니다. 그리고 다른 사람들의 선택과 비교도 해주고요. 검사 도중에 너무 자신을 자책하시지 마시고요.

moralmachine.mit.edu

인공 지능에 의한 윤리적 판단에 대하여 인간적 관점을

일반 대중이 참여와 토론을 나눌 수 있는 공간 입니다.

OTV

OTV

Over the Vehicle

자율주행차 그 이상의 가치